tutorial python data analysis adalah pintu masuk praktis untuk mengubah data menjadi keputusan nyata. Dalam panduan ini, kamu akan mendapat alur kerja end-to-end: mulai dari menyiapkan lingkungan, memahami struktur data Python, mengambil dan membersihkan data dunia nyata, eksplorasi serta visualisasi, hingga langkah awal machine learning dan deployment ringan. Saya menekankan praktik langsung dengan contoh konkret—misalnya membaca file CSV penjualan, membersihkan missing value pada kolom harga, lalu memvisualisasikan tren musiman menggunakan Seaborn. Panduan ini cocok untuk pemula yang ingin cepat produktif: kamu tidak perlu latar belakang matematika mendalam, cukup rasa ingin tahu dan kemauan praktik. Kamu juga akan belajar manajemen environment menggunakan Conda atau virtualenv, struktur proyek yang rapi, serta kapan memilih Jupyter Notebook atau VS Code. Di setiap bagian ada tip optimasi performa, contoh kode ringkas, dan studi kasus mini yang bisa kamu replikasi. Siap mulai? Kita akan bergerak langkah demi langkah sehingga kamu merasa lebih percaya diri mengolah data nyata dan membuat insight yang berdampak.

Persiapan: Instalasi & Lingkungan untuk Python untuk Analisis Data

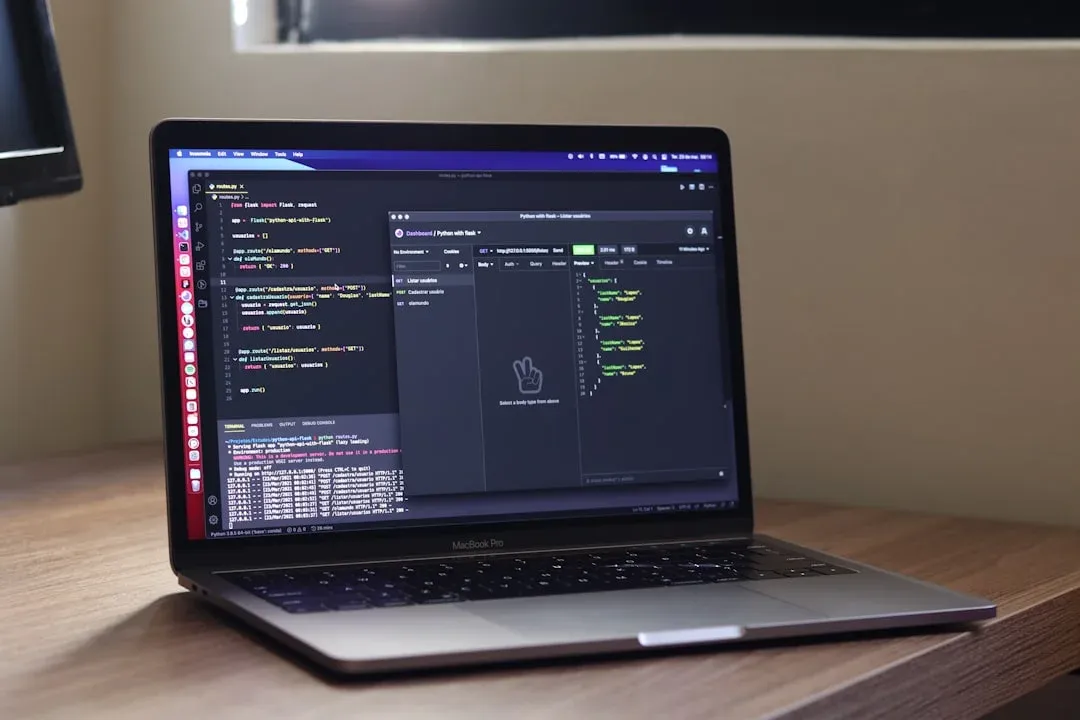

Mulai dari dasar. Pertama, pasang Python (3.8+). Pilih Conda untuk manajemen lingkungan jika kamu sering berganti paket. Contoh perintah: conda create -n analytics python=3.9 lalu conda activate analytics. Alternatif ringan: python -m venv venv dan pip install -r requirements.txt. Library inti yang wajib kamu kenali: NumPy untuk array dan operasi vektorisasi; Pandas untuk Series dan DataFrame; Matplotlib dan Seaborn untuk plotting; SciPy untuk statistik; scikit-learn untuk modeling. Pasang paket dasar dengan: pip install numpy pandas matplotlib seaborn scipy scikit-learn jupyterlab. Tools & workflow: Jupyter Notebook berguna untuk eksplorasi interaktif; VS Code nyaman untuk development dan debugging; gunakan Git untuk version control. Struktur proyek yang direkomendasikan:

- data/ (raw, processed)

- notebooks/ (EDA, prototyping)

- src/ (modular code)

- reports/ (figures, outputs)

- requirements.txt

Contoh kasus: dataset penjualan e-commerce 100k baris. Dengan virtual environment terpisah, kamu bisa bereksperimen tanpa merusak setup lain. Keuntungan Conda: dependency binary seperti SciPy lebih mulus. Kekurangan: ukuran lebih besar. Pilih sesuai kebutuhan.

Dasar-dasar Python dan Struktur Data untuk Analisis Data dengan Python

Pahami tipe data dasar: int, float, str, bool. Lalu kenali struktur koleksi: list, tuple, set, dict. NumPy membawa array n-dimensi yang cepat; contoh: arr = np.array([1,2,3]) dan operasi vektorisasi mengeliminasi loop Python sehingga lebih cepat. Pandas menyediakan Series dan DataFrame: Series = satu dimensi; DataFrame = tabel dua dimensi. Contoh operasi umum: indexing dengan df.loc atau df.iloc, slicing, filtering kondisi, merge, join, dan pivot. Gunakan df.describe() untuk ringkasan statistik cepat. Fungsi, lambda, dan apply berguna, namun ingat overhead apply lebih besar dibanding vectorized ops. Optimasi performa:

- Gunakan dtypes yang sesuai (category untuk kategori, float32 jika cukup)

- Hindari apply jika bisa diganti operasi vektorisasi

- Gunakan chunking untuk file besar

Contoh konkret: mengonversi kolom tanggal ke datetime pd.to_datetime(df.date), lalu ekstrak fitur seperti bulan atau hari. Studi kasus singkat: dataset transaksi—menggunakan groupby untuk hitung revenue per produk dan sort untuk top sellers. Kombinasikan pivot_table untuk ringkasan lintas dimensi. Analogi: DataFrame seperti lembar kerja dinamis yang bisa kamu filter, agregasi, dan transformasi seperti tukang kayu yang membentuk bahan mentah menjadi furnitur berguna.

Akuisisi Data & Pembersihan: Tutorial Python Data Analysis untuk Data Real-World

Mengambil data bukan selalu sekadar membaca CSV. Kamu akan berhadapan dengan Excel, JSON, SQL, API, dan web scraping. Contoh perintah: pd.read_csv('data.csv'), pd.read_excel('file.xlsx'), atau query SQL via SQLAlchemy. Untuk API gunakan requests dan parsing JSON. Web scraping: gunakan BeautifulSoup atau Scrapy untuk skenario kompleks. Pembersihan data tipikal: hilangkan duplikasi df.drop_duplicates(), tangani missing values dengan imputasi median atau metode domain-specific, deteksi outlier via IQR atau z-score. Transformasi data penting: konversi tipe, normalisasi numerik, encoding kategori (one-hot, ordinal), dan feature engineering dasar seperti rasio atau log-transform untuk skewed data.

- Contoh: imputasi harga yang hilang dengan median per kategori produk

- Contoh: encoding metode pembayaran menjadi dummy variables untuk modeling

Studi kasus: dataset pelanggan dengan 200k baris—setelah pembersihan, ukuran berkurang 10% karena duplikat dan missing. Untuk pipeline reproducible, gunakan fungsi modular dalam src/ dan simpan versi dataset processed. Tabel perbandingan metode imputasi membantu memilih solusi:

| Metode | Kelebihan | Kekurangan |

|---|---|---|

| Mean | Mudah, cepat | Sensitif outlier |

| Median | Robust terhadap outlier | Tidak mempertimbangkan distribusi |

| Mode | Bagus untuk kategori | Tidak cocok numerik |

| Interpolation | Memanfaatkan tren waktu | Asumsi linearitas |

| Model-based | Lebih akurat | Kompleks & mahal |

Eksplorasi Data, Visualisasi, dan Statistik Deskriptif untuk Analisis Data dengan Python

EDA adalah langkah investigasi awal. Mulai dengan summary statistics: mean, median, std, quantiles via df.describe(). Gunakan groupby dan pivot_table untuk analisis segmentasi. Visualisasi: Matplotlib untuk kontrol detail; Seaborn untuk plot statistik cepat (hist, box, heatmap); Plotly untuk interaksi. Contoh: visualisasi korelasi menggunakan heatmap untuk identifikasi multikolinearitas. Statistik dasar termasuk uji hipotesis sederhana (t-test), korelasi Pearson/Spearman, dan confidence intervals. Contoh studi kasus: kamu menemukan korelasi 0.6 antara diskon dan volume penjualan—apakah itu sebab-akibat? Gunakan eksperimen A/B atau analisis time series lebih lanjut.

- Plot distribusi:

sns.histplot(df.price, kde=True) - Boxplot per kategori:

sns.boxplot(x='category', y='price', data=df) - Heatmap korelasi:

sns.heatmap(df.corr(), annot=True)

Perbandingan visualisasi untuk insight:

| Plot | Use-case | Keunggulan |

|---|---|---|

| Histogram | Distribusi | Cepat & sederhana |

| Boxplot | Outlier | Ringkas per kelompok |

| Heatmap | Korelasi | Visual korelasi matriks |

| Line plot | Time series | Tunjukkan trend |

| Scatter | Relasi dua variabel | Identifikasi pola |

Analisis Lanjutan, Machine Learning Dasar, dan Produksi

Setelah EDA, langkah selanjutnya adalah modeling sederhana. Regresi linier untuk prediksi numerik, klasifikasi (Logistic Regression, Random Forest) untuk target kategorikal. Gunakan scikit-learn pipeline untuk preprocessing dan modeling: Pipeline([('scaler', StandardScaler()), ('model', RandomForestClassifier())]). Evaluasi dengan cross-validation dan metrik yang relevan: RMSE untuk regresi, accuracy/precision/recall/F1 untuk klasifikasi. Untuk time series gunakan ARIMA, Prophet, atau model berbasis machine learning dengan fitur time-lag. Untuk dataset besar, pertimbangkan Dask atau Vaex agar muat di memori dan mempercepat proses.

- Contoh pipeline sederhana: scaling -> feature selection -> model

- Cross-validation: gunakan

cross_val_score

Reproducibility penting: simpan seed, dokumentasikan dependencies, dan pisahkan script produksi dari notebook prototyping. Deployment dasar: jadikan model sebagai script CLI atau API sederhana menggunakan Flask/FastAPI. Studi kasus implementasi: model churn prediksi meningkatkan retensi 5% setelah integrasi rekomendasi. Ingat, produksi bukan akhir—monitoring model dan feedback loop diperlukan untuk memastikan model tetap relevan.

Kesimpulannya, tutorial python data analysis ini membawa kamu dari setup lingkungan hingga deployment ringan. Mulai praktikum kecil: pilih dataset sederhana, buat notebook EDA, lakukan pembersihan, lalu coba model dasar. Terapkan best practice: environment terpisah, struktur proyek konsisten, dan pipeline reproducible. Langkah terdepan: deploy model sederhana dan ukur dampaknya—apakah memengaruhi keputusan bisnis? Jika ya, skalakan dengan monitoring dan pipeline otomatis. Terus belajar: eksperimen, baca kode orang lain, dan kontribusi pada proyek nyata. Dengan langkah bertahap, kamu akan berubah dari pemula menjadi praktisi yang mampu mengubah data menjadi solusi berdampak melalui tutorial python data analysis.